A közösségi média platformok működésének egyik jellegzetessége a felhasználók által feltöltött és megosztott tartalmak moderálása. Ahogyan a bejegyzéssorozat első részéből kiderült, ezt gyakran automatizált eszközökkel valósítják meg a szolgáltatók, a szűrés azonban sokszor nem tökéletes. A sorozat második része azt mutatta be, hogy milyen lehetőségeik vannak azoknak, akik nem tartják megfelelőnek a szolgáltatói döntést. A korábbi két bejegyzés középpontjában a moderálásnak az a fajtája állt, amelyet a platformok a saját közösségi irányelveik megsértése miatt végeznek. Ezek a szabályok azonban nem jogszabályok, hanem a platformok saját belső szabályai, amelyekkel a felhasználók magatartását befolyásolják.

A felhasználók online tevékenységére nem csak szolgáltatók belső szabályzatai vannak hatással, az államok világszerte törvényekkel és más jogszabályokkal szabályozzák a polgárok megatartását, a fizikai tér mellett a virtuális világban is. Van néhány olyan tilalom, amelyben a nemzetközi közösség egyetért, így világszinten érvényesülnek, ilyen például a gyermekek szexuális bántalmazását ábrázoló felvételek közzétételének, a gyűlöletbeszédnek, illetve a terrorizmusra uszításnak a tilalma. Ezektől eltekintve azonban a szabályok országról országra különböznek, főként a helyi sajátosságok és a kulturális különbségek miatt. Thaiföldön például tilos az uralkodót illetve a családját kritizáló, gúnyoló képeket közzétenni, míg az iszlám országok a Mohamed prófétáról készült rajzokat, karikatúrákat tiltják. A platformok többsége tudomásul veszi a helyi sajátosságokat és létrehozott egy eljárást, amelyben az állami szervek jelezhetik, ha egy tartalom helyi jogszabályba ütközik.

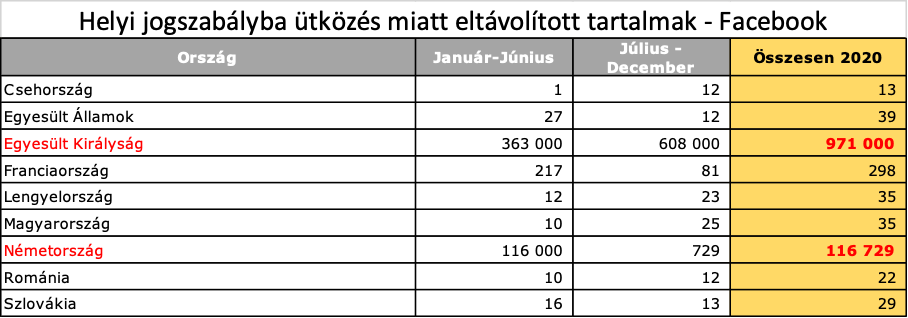

A vizsgált 2020-as átláthatósági jelentésekből nyert adatok azt mutatják, hogy az államok nem sok esetben élnek ezzel a lehetőséggel. Noha az említett jelentések minden országról tartalmaznak adatokat, e bejegyzésben hazánkon kívül csak az EU nagyobb tagállamait (Németország, Franciaország), régiónk országait (Csehország, Lengyelország, Románia, Szlovákia), továbbá az Egyesült Királyságot és a cégek hazájául szolgáló Amerikai Egyesült Államokat vizsgáljuk. Az adatokból arra derül fény, hogy míg a közösségi irányelvek megsértése miatti moderálás statisztikáinak közzétételére nagy hangsúlyt fektetnek a szolgáltatók, a helyi jogszabályba ütközés miatti megkeresésekről szóló statisztikákra már jóval kisebbet. A Facebook például az állami megkeresések alapján eltávolított tartalmak számát nyilvánosságra hozza, arról azonban már nincs adat, hogy összesen hány megkeresés érkezett a vizsgált időszakban és hánynak a teljesítését utasította el, vagy hagyta figyelmen kívül. A Facebook által közzétett számokból látszik, hogy azokban az országokban magas az eltávolított tartalmak száma, ahol szigorúbb helyi jogszabályok is vonatkoznak a közösségi médiában megjelenő tartalmakra. Németországban ez a jogszabály a NetzDG, az Egyesült Királyságban pedig a Communications Act 2003, Malicious Communications Act 1988, Protection From Harassment Act 1997.

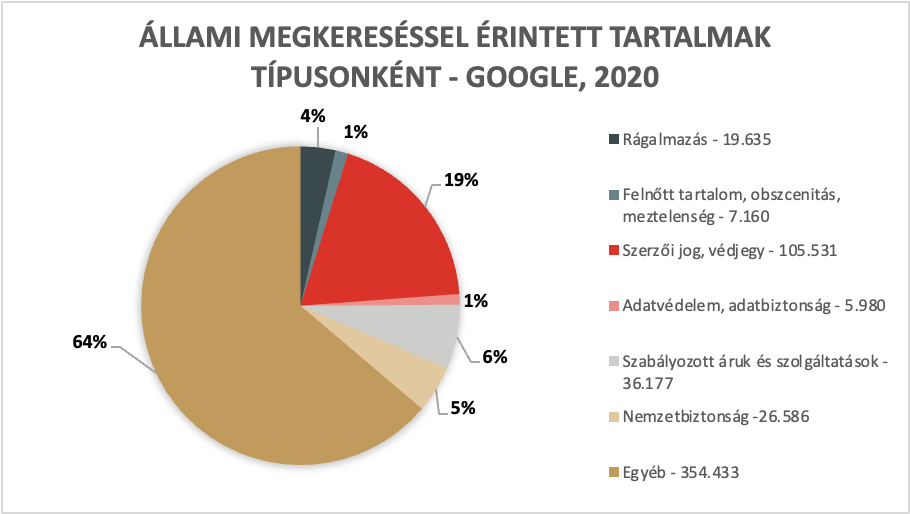

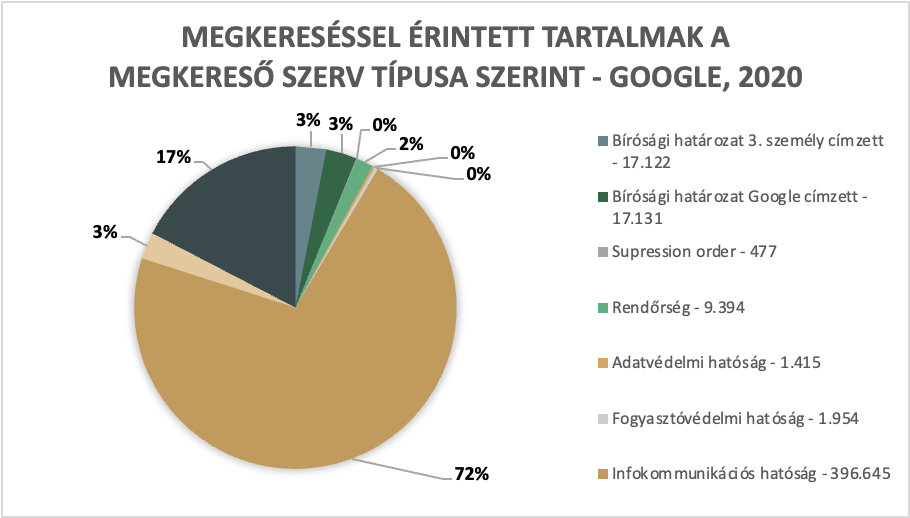

Részletesebb adatokat szolgáltat a Google és a Twitter, előbbi például tartalomtípusonkénti bontásban is meghatározza, hogy hány elemmel kapcsolatban érkezett panasz, valamint a megkereső szerv fajtájáról is statisztikát vezet.

A globális számokat vizsgálva a Google termékeivel kapcsolatban a legtöbb állami megkeresés (az egyéb kategóriát nem számítva) szerzői jogi okokból érkezik. Második és harmadik helyen a szabályozott árukkal és szolgáltatásokkal (például gyógyszerek, gyógyászati segédeszközök, alkoholtartalmú termékek), illetve a nemzetbiztonsággal kapcsolatos panaszok állnak.

Globális viszonylatban a legtöbb tartalom ellen az infokommunikációs hatóságok élnek megkereséssel. Ezt követi az egyéb kategória, ahova az egyes országok eltérő államigazgatási rendszeréből következően nem kategorizálható szervek tartoznak. Viszonylag jelentős részt képviselnek a bírósági határozatok, amelyek két típusba tartozhatnak, az egyik az olyan bírósági határozat, amelynek a cég a közvetlen címzettje, illetve a harmadik személyeket kötelező bírósági határozat. Ilyen eset fordulhat elő, ha mondjuk egy rágalmazó tartalom közzétevőjét a bíróság kötelezi a kérdéses tartalom eltávolítására és ez a kötelezett nem tesz eleget az eltávolítási kötelezettségének. A platformszolgáltató a bírósági határozat alapján ilyen esetekben eltávolíthatja maga is az adott tartalmat. A rendőrségek, adatvédelmi és fogyasztóvédelmi hatóságok ellenben nem sok tartalom ellen éltek panasszal a 2020. évben.

Mind a Google, mind a Twitter statisztikái azt mutatják, hogy a szolgáltatók nem tesznek automatikusan eleget az állami megkereséseknek, sőt meglehetősen nagy arányban utasítják el azokat. A Twitter 2020 első félévében például csak a bíróság határozatok 19%-a esetében hozott intézkedést, míg az egyéb megkereséseknek is csak a 32%-át teljesítette. Hasonló számokat láthatunk a Google esetében is, amely az átláthatósági jelentésében kifejezetten említést tesz arról, hogy az állami szervek felől érkezett megkereséseket megvizsgálja és dönt arról, hogy azokat jogsértőnek tekinti-e. A platformok szívesen indokolják ezt a gyakorlatot azzal, hogy így biztosítják a felhasználók véleménynyilvánítási szabadságának érvényesülését szemben az esetleges állami önkénnyel, de gyakorta hivatkoznak arra is, hogy nekik csak a letelepedési helyük szerinti ország jogával összefüggésben kell vizsgálniuk a tartalmakat. Az állami megkeresések kapcsán tevékenységük azonban elvi és gyakorlati síkon is kifejezetten problémás. Elvi síkon ugyanis ez a gyakorlat azt jelenti, hogy a platformok felülemelkednek az állami szuverenitáson és magukat a nemzeti jogrendszerek fölé helyezik, hiszen a gyakorlatban bármely állam, bármely szervének – akár bíróságának – bármelyik döntését a platformjukon megjelenő tartalom vonatkozásában megkérdőjelezhetik, korlátozva ezzel egyes állami funkciók ellátását. Gyakorlati szempontból a problémát az jelenti, hogy az állami megkeresések helyességének vizsgálatához az egyes országok jogrendszereinek, jogszabályainak és hagyományainak átfogó ismerete szükséges, amellyel tengerentúli cégek vélhetően csak korlátozottan rendelkeznek.

Az átláthatósági jelentések alapján tehát még sok a teendő a közösségimédia-platformok moderálási gyakorlatának fejlesztése során, különösen igaz ez az állami megkeresésekre. Több szolgáltató esetében fontos feladat lenne az átláthatóság további növelése, valamint az olyan eljárásrendek kidolgozása, amelyek minden érintett számára kielégítő megoldást kínálnak.