Avagy hogyan szűri a közösségi média a tartalmakat? (2. rész)

Blogbejegyzés sorozatunk első részében azt tekintettük át, hogy nagyobb közösségi média platformok hány tartalmat töröltek a közösségi irányelveik megsértése miatt a 2020-as év folyamán. Arról is szó esett, hogy a tartalmak többségét a szolgáltatók nem manuálisan, hanem mesterséges intelligencia alapú algoritmusok segítségével szűrik. Sajtóhírekből gyakran hallunk arról, hogy az algoritmusok nem reagálnak tökéletesen. A Facebook például a meztelenség tilalmára vonatkozó irányelv megsértése miatt törölte olyan szobrok képeit, mint a dániai kis hableány szobor vagy a bolognai Neptun szobor, de olyan ikonikus fotók is a moderálás áldozatává váltak, mint a vietnami napalmtámadás elől menekülő kislányról készült Pulitzer-díjas kép. A YouTube a történelemtanárok által feltöltött Hitlerről készült archív felvételeket törölte a gyűlöletkeltő tartalmakra vonatkozó szabályaira hivatkozva, a christchurch-i terrortámadásról készült felvételek moderálásával viszont nehezen tudott megbirkózni.

A nagy nyilvánosságot kapó eseteket hosszasan sorolhatnánk, hiszen egyes becslések szerint csak a Facebook naponta 300 ezer moderálási hibát vét. Az egy évben moderált tartalmak milliárdos számához képest a platform számára ez a szám vélhetően a hibahatáron belül van, a véleménynyilvánítás szabadságának online érvényesülése szemszögéből nézve viszont meglehetősen kedvezőtlen. Már több tanulmány rámutatott arra, hogy a döntést hozó algoritmusok nem döntenek diszkriminációmentesen, és ha az automatikus tartalommoderálás valamilyen oknál fogva hibás, az ahhoz vezet, hogy egyes felhasználóknak csorbul a nyilvános vitákban részvételhez való joga.

A mesterséges intelligenciát használó algoritmusoktól – a jelenlegi technológiai fejlettségi szint mellett – egyelőre nem szabad csodát várni. Ahogy az algoritmusok tanulnak és fejlődnek, eljön majd az idő, amikor szükségtelen lesz az emberi kontroll, a jelenlegi megoldások azonban még nem teszik lehetővé a káros, közösségi irányelvekbe ütköző tartalmak teljeskörű moderálását. Éppen ezért jelenleg fokozott szükség van az emberi felügyeletre és arra, hogy a döntések ellen a felhasználók panaszt tehessenek.

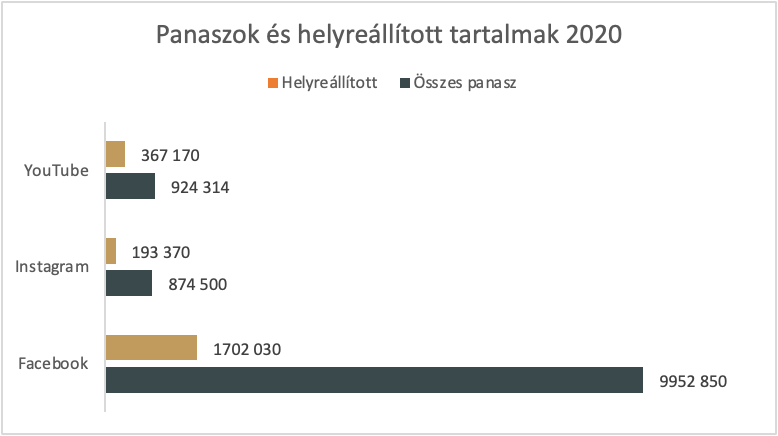

A nagy közösségi média platformok átláthatósági jelentéseit elemző kutatás arra jutott, hogy a hibás döntések korrekciója ritkán következik be. 2020-ban a Facebook az összes moderálással érintett tartalomnak csupán a 2 százalékát, az Instagram az 1 százalékát állította vissza, a Twitter és a TikTok pedig egyáltalán nem tesznek közzé helyreállításról szóló adatokat.

A törölt vagy blokkolt tartalmak visszaállítására két úton kerülhet sor: az egyik, ha a szolgáltató maga észleli a hibáját, a másik pedig, ha felhasználói panasz érkezik, amelyet megvizsgálva a platform korrigálja a saját döntését. A vizsgált szolgáltatók mindegyike biztosítja a felhasználói panasz lehetőségét, a panasztétel eredményéről azonban csak a Facebook, az Instagram és a YouTube átláthatósági jelentéseiben találunk részletes statisztikát.

Azoknál a platformoknál, ahol találunk a moderálás elleni panaszokra vonatkozó adatokat, azt láthatjuk, hogy csekély a felhasználók hajlandósága a panasztételre és nem kimondottan élnek a lehetőséggel. A Facebook felhasználók mindössze az esetek 0,08 százalékban, az Instagram felhasználói az esetek 0,82 százalékában, a YouTube felhasználói pedig az esetek 2,66 százalékában éltek a panasztétel lehetőségével. Kicsi az esélye annak is, hogy a panasz alapján egy adott tartalom helyreállításra kerül, a Facebook csupán a panaszosok 17 százalékát ítélte jogosnak és állította vissza a tartalmat, míg az Instagram a panaszt tevő felhasználók 22 százalékának, a YouTube pedig 40 százalékának adott igazat.

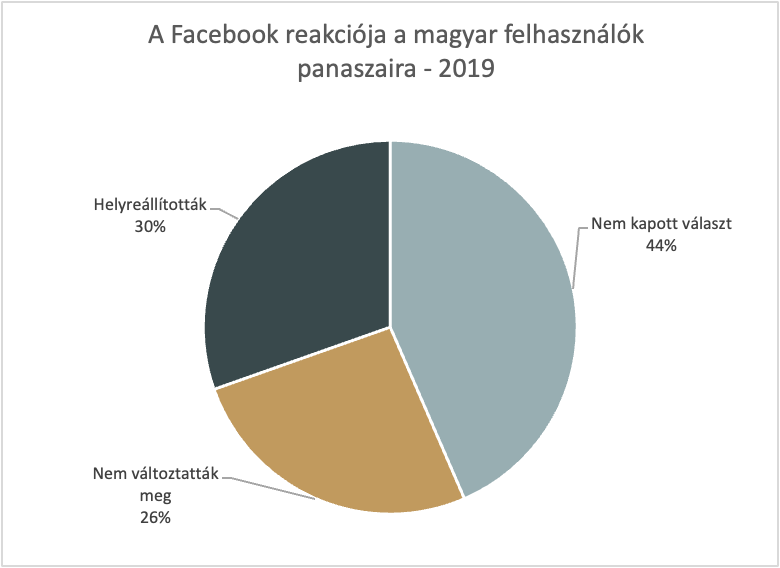

Ezek a 2020-as számok hasonlóak az Információs Társadalom Kutatóintézet 2019-ben végzett reprezentatív kutatásának az adataihoz, amely a magyar felhasználókat kérdezte többek közt arról, hogy élnek-e a panasz lehetőségével, amennyiben igazságtalannak tartják a Facebook döntését. A magyar felhasználók e tekintetben tudatosabbak, mint a szolgáltató átláthatósági jelentésében szereplő átlagos felhasználó, hiszen a magyar Facebook-használók 36,5 százaléka hangot adott sérelmének. Az esetek 63,5 százalékában azonban a magyar felhasználók sem kérdőjelezték meg a moderálás helyességét.

A panaszt tévő felhasználók 43,5 százaléka Facebooktól semmilyen választ nem kapott a panaszára, az esetek 26,1 százalékában a szolgáltató nem találta jogosnak a panaszt és nem változtatta meg a döntését, s helyreállításra csupán az esetek 30,4 százalékában került sor. 2021 áprilisa óta a Facebook és az Instagram felhasználói már az Ellenőrző Bizottsághoz (Oversight Board) is fordulhatnak, ha a szolgáltató nem megfelelően járt el ügyükben. Ez az intézmény azonban annyira friss, hogy még nem szolgáltatott elemezhető ügystatisztikát.

A jelenlegi kontrollmechanizmusok két ok miatt sem felelnek meg a hatékony emberi felügyelettel szemben támasztott elvásároknak. Egyrészt a szolgáltatók többsége nem szolgáltat semmilyen adatot arról, hogy hány esetben ítélik hibásnak a saját moderálási döntéseiket, sem pedig arról, hogy mi a felhasználói panaszok sorsa. Ez alól gyakorlatilag csak a három legnagyobb szolgáltató (a Facebook, az Instagram és a YouTube) képez kivételt. A másik ok, amely arra mutat rá, hogy a jelenlegi felülvizsgálati rendszerek nem megfelelőek, hogy a felhasználók jellemzően inkább elfogadják a szolgáltatói döntéseket, a hibás döntések többségét a platformok saját észlelés alapján korrigálják, amelynek a mechanizmusáról kevés adat érhető el. A felhasználói panaszokat a szolgáltatók a legtöbb esetben indokolatlannak találják.

A moderálással nem csak az indokolatlan eltávolítások esetében lehet probléma, az alul-moderálás szintén okoz nehézségeket, különösen akkor, ha egy tartalom eltávolítása nem egy szolgáltató saját szabályzatát sérti, hanem valamelyik ország helyi jogszabályaiba ütközik. Következő bejegyzésünkben ezért azt vizsgáljuk meg, hogy hogyan kezelik a platformok a helyi jogszabályokba ütközésre hivatkozó állami megkereséseket.